Implementación de un Sistema de Búsqueda Automatizada en Información con Inteligencia Artificial

Autor: Francisco Prats Quílez

Introducción

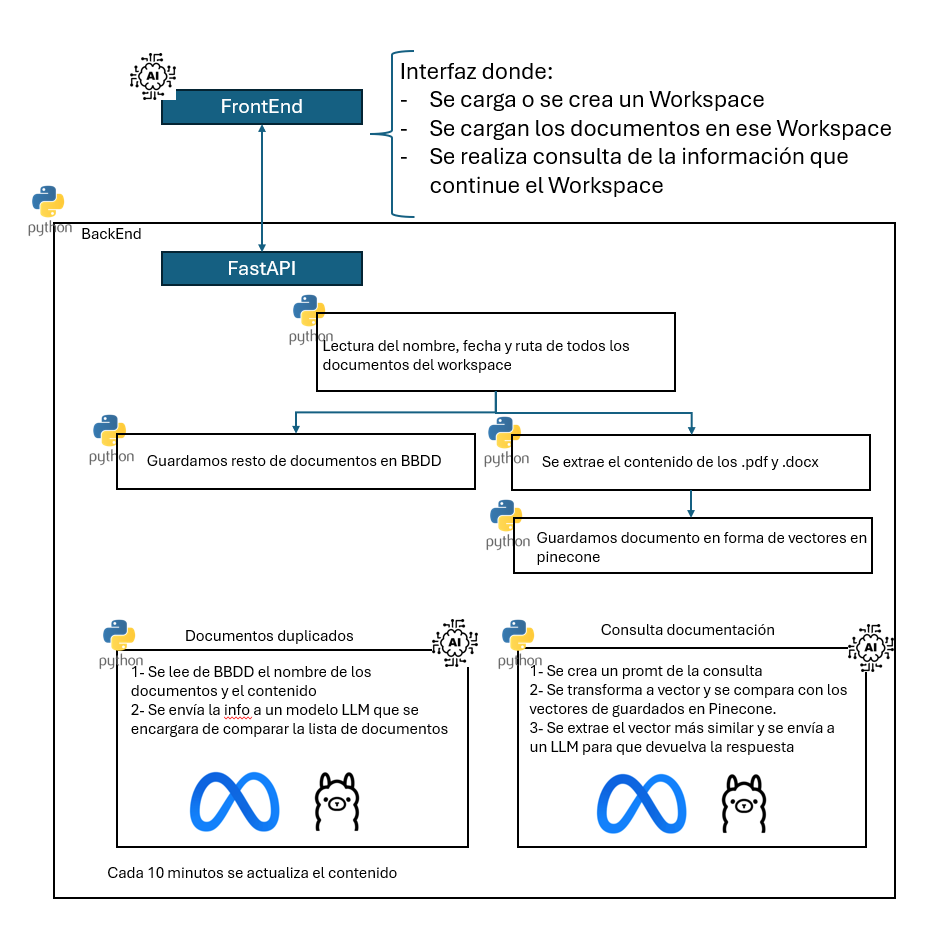

En la era de la información, el manejo eficiente de documentos es crucial para la productividad empresarial. Las organizaciones acumulan grandes volúmenes de datos en forma de documentos, lo que hace imperativo contar con herramientas avanzadas para gestionar y extraer información relevante de manera rápida y precisa. El presente estudio analiza la implementación de un sistema automatizado de búsqueda de información en documentos utilizando modelos de inteligencia artificial en local, integrados en la aplicación Project Manager AI.

Objetivo

El objetivo de este proyecto es desarrollar una solución automatizada que permita la gestión y búsqueda eficiente de información en documentos almacenados en diversos formatos (docx y pdf). Se busca optimizar el proceso de carga, monitoreo, consulta y actualización de documentos utilizando técnicas avanzadas de procesamiento de lenguaje natural (NLP), particularmente modelos de lenguaje de gran tamaño (LLM) y bases de datos vectoriales.

Desarrollo

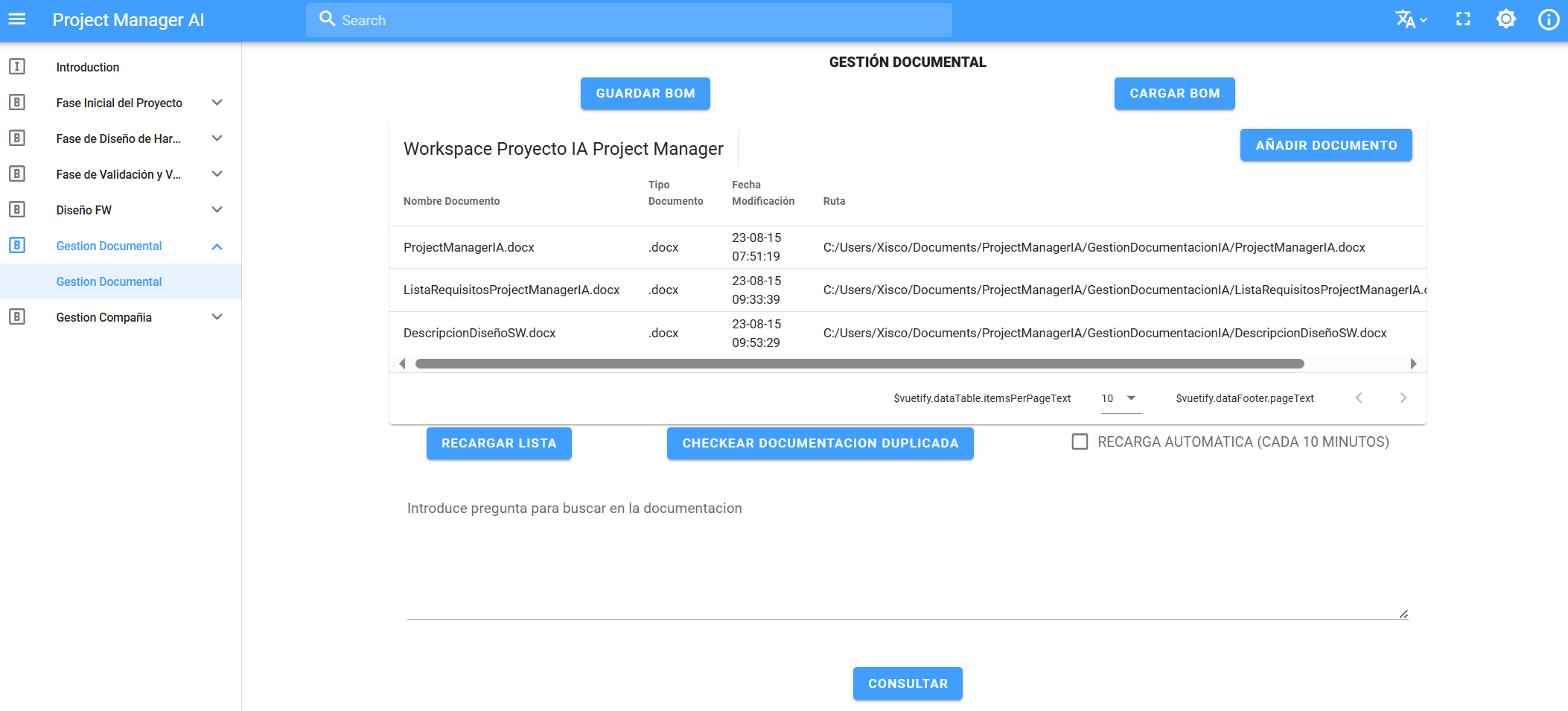

1. Creación y Selección de Workspace

- Se inicia el proceso utilizando la aplicación Project Manager AI en el apartado de gestión documental.

- El usuario puede crear un nuevo workspace o seleccionar uno existente, especificando una ruta donde se cargarán los documentos.

2. Carga de Documentos

- Los documentos en formatos docx y pdf se convierten a vectores y se almacenan en una base de datos vectorial de Pinecone.

- La interfaz permite monitorear los documentos, agregar nuevos, eliminar o abrir los existentes, y realizar búsquedas por nombre de documento.

3. Actualización y Monitoreo

- Al pulsar en "Recargar Lista", se recargan en la base de datos vectorial los documentos que hayan sido modificados.

- Existe la opción de realizar una recarga automática cada 10 minutos para mantener la base de datos actualizada.

4. Detección de Documentación Duplicada

Un modelo de LLM se encarga de identificar documentos duplicados dentro del workspace, mejorando la organización y evitando redundancias.

5. Consultas de Información

- Se emplea la técnica RAG (Retrieval-Augmented Generation) para realizar consultas sobre la documentación cargada.

- El sistema genera un vector de consulta y busca coincidencias en la base de datos vectorial.

- Una vez identificado el documento o sección relevante, un modelo LLM en local procesa y muestra la respuesta en la interfaz.

Conclusiones

La implementación del sistema automatizado de búsqueda de información en documentos ha demostrado ser una herramienta poderosa para la gestión documental. La capacidad de convertir documentos a vectores y almacenar estos en una base de datos vectorial permite búsquedas rápidas y precisas. Además, la integración de modelos LLM mejora significativamente la calidad y relevancia de las respuestas obtenidas.

El sistema no solo facilita la gestión de grandes volúmenes de documentos, sino que también asegura la actualización continua y la eliminación de duplicados, optimizando el flujo de trabajo y reduciendo el tiempo dedicado a la búsqueda de información.

Al tratar con información que en mucho de los casos puede ser confidencial, se utiliza un modelo open source en local, llamado llama3.

Futuro Desarrollo

1. Optimización de Prompts

- Mejorar los prompts utilizados por los modelos LLM para generar consultas más precisas y obtener respuestas más relevantes.

2. Expansión de Formatos de Documentos

- Ampliar la compatibilidad del sistema a otros formatos de documentos como HTML, TXT, etc.

3. Integración con Otros Sistemas

- Integrar el sistema con otras plataformas de gestión documental y herramientas de colaboración como SharePoint, Google Drive, y Slack.

4. Mejoras en la Base de Datos Vectorial

- Implementar técnicas avanzadas de vectorización y búsqueda para mejorar la velocidad y precisión de las consultas.

5. Interfaz de Usuario

- Desarrollar una interfaz de usuario más intuitiva y rica en funcionalidades para mejorar la experiencia del usuario final.